25年3月来自慕尼黑工大、瑞士 ETH 和微软的论文“VidBot: Learning Generalizable 3D Actions from In-the-Wild 2D Human Videos for Zero-Shot Robotic Manipulation”。

未来的机器人被设想为能够执行各种家务的多功能系统。最大的问题仍然是,如何在尽量减少机器人物理学习的同时弥合具身之间的差距,因为物理学习从根本上来说扩展性不强。从自然人类视频中学习,为机器人操作任务提供了一个有前途的解决方案,因为互联网上已经存在大量相关数据。这项工作提出 VidBot,一个实现零样本机器人操作的框架,使用从自然单目 RGB 人类视频中学习的 3D affordance。VidBot 利用一个流水线提取显式表征,即来自视频的 3D 手部的轨迹,结合深度基础模型和运动结构技术来重建与具身无关、时间一致、度量-尺度的 3D affordance 表征。其引入一种由粗到细的 affordance 学习模型,该模型首先从像素空间中识别粗略动作,然后利用扩散模型生成细粒度的交互轨迹。该模型以粗略动作为条件,并由测试时间约束引导,用于上下文-觉察的交互规划,从而能够大规模泛化到新的场景和具身。大量实验证明 VidBot 的有效性,它在零样本环境下的 13 项操作任务中显著优于其他同类模型,并且可以在现实环境中无缝部署到机器人系统中。VidBot 为利用日常人类视频提高机器人学习的可规模化铺平道路。

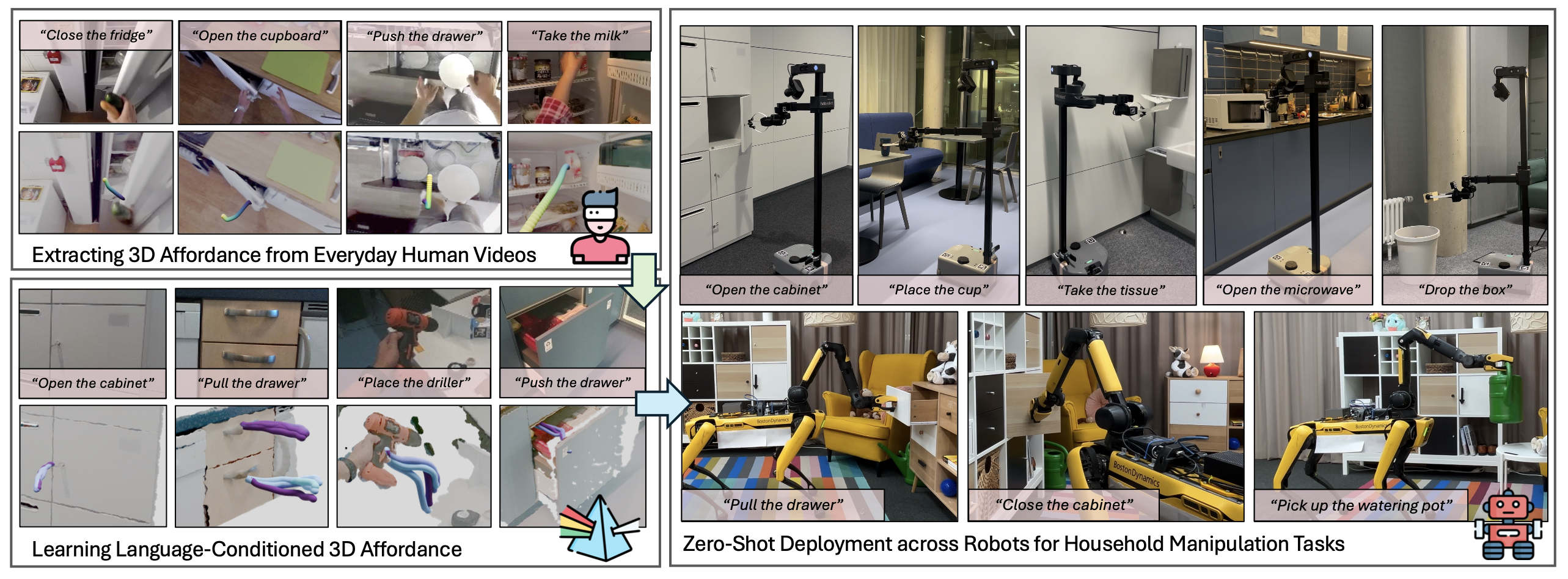

如图所示 VidBot:

人工智能的进步正在加速个性化设备的开发,例如为用户提供虚拟指导的智能眼镜 [13, 22, 28, 62]。在不久的将来,机器人也将成为类似于智能手机或智能眼镜的个性化系统,旨在为人类提供物理帮助。然而,机器人形态的多样性和新颖性,对在开放式环境中部署人工智能执行开放式任务构成重大挑战。

目前最先进的学习机器人操作技能方法,仍然严重依赖于人类专家的遥操作演示,这些演示用于在模仿学习 (IL) 范式下训练机器人策略 [35, 37, 64, 95]。然而,这一过程仍然成本高昂、耗时且劳动密集。虽然近期的努力已经收集用于日常操作任务的大规模机器人演示,例如 Open X-Embodiment [59] 和 DROID [39],但由于机器人实例、任务和环境的组合爆炸式增长,数据收集仍然具有挑战性。

人类视频提供一个有前途的可解决方案:目前有大量的网络视频捕捉到人类在各种环境中执行各种任务的场景。之前已有几种方法探索人-机技能迁移 [2, 3, 65, 73, 78, 79, 88, 97]。然而,它们面临着某些限制,例如需要静态摄像机或场景、深度传感器、动作捕捉系统等。这些限制通常导致实验室环境缺乏场景、照明或视点的多样性。有一系列研究探索利用具有丰富场景背景的互联网真人视频,来提升机器人学习任务,重点是学习视觉运动策略的视觉表征 [52, 57, 67, 85]。然而,一个主要的限制是依赖于人类在每个新环境中用每个新实例收集特定于任务的遥控数据来微调预训练的模型。最近,像 [4] 这样的工作通过明确提取与智体无关的交互轨迹取得进展。然而,这些提取出的运动被简化为像素空间中的二维矢量,限制它们直接部署到机器人上。除了局限于二维图像平面的视觉表征或像素级动作提示之外,三维 affordance ——具体来说,具有空间感知的接触点和交互轨迹——对于统一不同的实例以从感知中解释动作至关重要。然而,从日常人类视频中提取一般的 3D 舞蹈数据仍然是一个巨大的挑战,阻碍了机器人通过观察人类来学习操纵技能。

视觉 affordance 学习。核心在于确定智体应在何处以及如何与给定场景进行交互。一项研究使用手动注释的数据集回归 affordance [16, 19, 20, 55]。然而,收集 affordance 标签的成本非常高昂。因此,最近的一项研究通过在模拟环境中部署智体来探索有效交互来解决这一挑战 [12, 24, 54, 58, 83]。尽管这些方法提供一种无需人工干预的数据收集替代方案,但它们通常会受到获取各种虚拟资产的成本限制。相比之下,人类视频作为 affordance 先验的更通用来源而备受关注。一些方法 [4, 27, 48, 56] 利用人类视频中的手与物体接触标签来预测每像素 affordance 得分。然而,这些流程通常仅识别接触区域或模拟图像平面内的交互动作,缺乏空间感知。近期的研究 [7, 92] 尝试利用流作为空间感知的 affordance 表征来解决这一限制。然而,这些方法需要在测试时提供目标图像或初始接触区域。

机器人向人类学习。先前的研究已经探索利用人类视频来辅助机器人学习任务。一种方法是从人类视频中学习视觉表征,并使用预训练的视觉编码器来训练策略网络 [6, 52, 57, 67, 82, 85, 89]。另一类研究则侧重于从人类视频中学习奖励函数 [3, 10, 11, 43, 47, 75, 78, 86, 88]。此外,一些研究还使用从视频中提取的运动属性,例如估计 3D 手势或跟踪手腕轨迹 [5, 61, 65, 73, 74, 78, 79, 91]。然而,这些方法通常仅限于实验室设置和/或需要人类专家进行进一步的遥操作演示。[4] 使用日常人类视频来提取与具身无关的动作。然而,其推断的二维像素级运动过于简单且模糊,限制了其直接部署到机器人上。

机器人中的扩散模型。扩散模型是一种强大的学习范式,它通过迭代去噪过程来近似复杂的数据分布。近年来,它们已在各种生成式建模应用中取得了成功[15, 23, 31, 32, 40, 68–70, 81, 96]。在机器人领域,扩散模型已被证明是强大的策略学习框架[1, 14, 36, 38, 45, 46, 51, 84]。扩散策略[14]引入一个通用框架,用于通过条件去噪扩散过程生成多模态机器人轨迹。扩散器[36]通过结合奖励函数增强引导轨迹采样。后续研究[46, 51, 84]提出更具因式分解的策略学习框架,使扩散模型能够在关键步骤之间生成平滑的动作。然而,这些方法侧重于回归极其有限的域内遥操作数据,且在测试过程中不存在模态或具身方面的差距。

本文采用一种原则性方法,利用运动恢复结构(SfM)进行机器人学习,开发一种基于梯度的优化流水线,从野外视频中提取 3D 手部轨迹。同时引入一个由粗到细的 affordance 学习框架,以便从提取的各种训练数据中学习丰富的动作。

目标是从日常人类视频中学习一个分解的 affordance 模型 a = π({I ̃, D ̃}, l),其中 {I ̃, D ̃} 是 RGB-D 帧(图像 ̃I,深度 D ̃),l 是语言指令。注意,深度帧可以从深度传感器或度量-深度基础模型获得 [8, 90]。由于 affordance 表征预计与具身无关,按照先前的研究 [4, 48] 将最终输出 affordance 表示 a 公式化为接触点 c 和交互轨迹 τ,同时将此公式扩展到 3D 空间。具体而言,a = {c, τ}。N_c 是接触点的数量,H 是轨迹范围。注意,a 在观察相机的帧中表征。

从人体视频中获取 3D Affordance

首先设计一个流程,用于从移动单目相机记录的日常人体视频中提取 3D 手部轨迹,其中每帧的姿态和位置均未知。

数据准备:给定一段包含彩色图像的视频 {ˆI_0,…,ˆI_T } 和语言描述 l,首先使用 SfM 系统 [71] 估计相机内参 K、每帧尺度未知的姿态 {T_WC_0,…,T_WC_T} 以及在世界坐标系中表达的稀疏特征点 {wl_0,…,wl_N_l}。利用度量-深度基础模型 [8, 33, 90] 来预测每帧的稠密深度 {Dˆ_0,…,Dˆ_T}。进一步利用手部-物体检测模型 [72] 和分割模型 [41, 94] 来获取每帧手部和接触物体的掩码,即 {M_0h,…,M_Th}、{M_0o,…,M_T^o}。

利用提供的手部掩码,进一步收集 I_0 之前的帧及其手部掩码,使用视频修复模型 [44] 获得无手的帧 { ̃I_0 , …, ̃I_T}。

一致性姿态优化。首要目标是将相机姿态校正到度量空间尺度。为了实现这一目标,利用相机内参及其姿态,将稀疏特征点投影到每个图像平面,从而优化所有帧的全局尺度 s_g。然后,优化所有帧的姿态 T_WC_i 和尺度 s_i,以补偿由于手部-物体动态运动导致的 SfM 重建误差,同时使预测的深度在不同视图之间更加一致。

Affordance 提取。获取每一帧的手部中心点,并将其变换到具有精确姿势和尺度的第一帧,以计算交互轨迹τˆ。在第一帧中均匀地下采样手部点以获取接触点 cˆ,并从最后一帧中获取目标点 gˆ,以监督 affordance 模型的中间预测。语言描述 l、来自[90]的修复颜色̃ I_0 及其深度̃ D_0,以及使用 M_0o 裁剪的修复目标图像̃ I_0^o 被用作模型输入。利用EpicKitchens-100 Videos数据集[18]及其由EpicFields[76]提供的SfM结果来展示流程的有效性。如图展示了提取的结果:

从粗到精的 affordance 学习

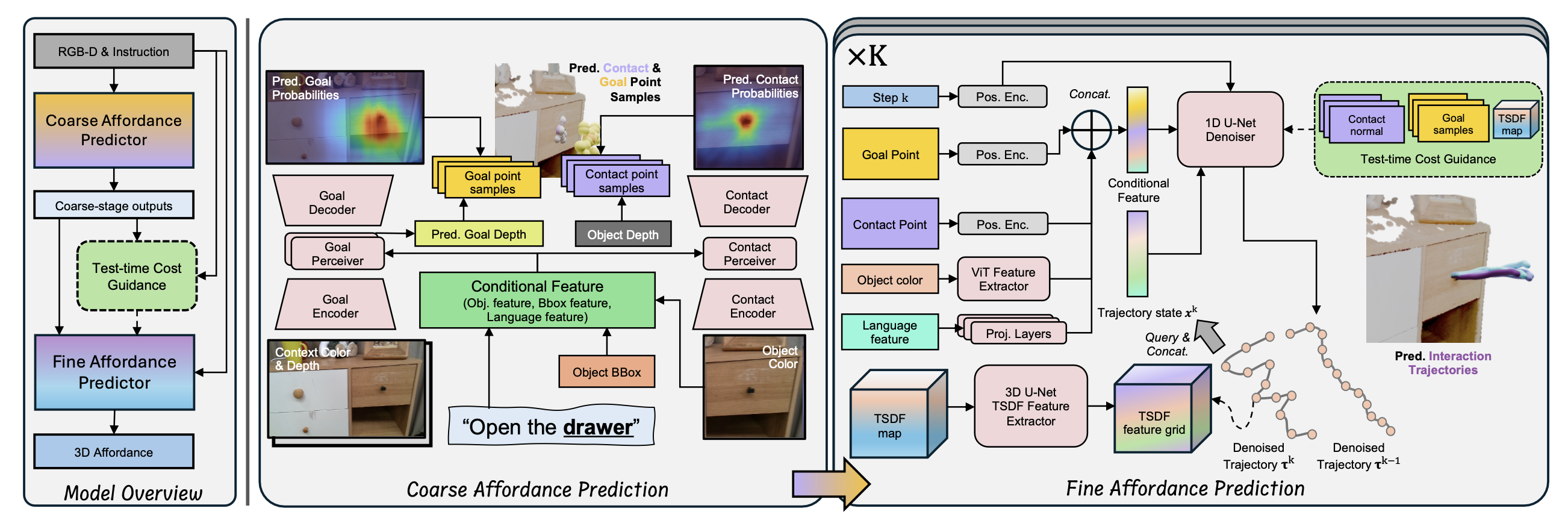

Affordance 模型概览如图所示。在设计模型时考虑两个关键因素:(1)它应该能够从大量自然人类 affordance 数据中捕捉基于观察和指令的动作分布。(2)它应该在测试期间利用上下文信息来缓解由于训练数据不完善而导致的具身差距和潜在的噪声预测,从而提高生成的 affordance 质量。

为了解决第一个因素,将 affordance 模型 π 分解为粗略模型 π_c 和精细模型 π_f。在粗略阶段,π_c 进行高级场景理解,以 RGB-D 帧 { ̃I, D ̃} 和指令 l 为条件推断出一组目标点 g 和接触点 c,即 {g, c} = π_c({ ̃I, D ̃ }, l), a_c = {g, c}。给定粗的阶段输出和任务输入,π_f 在低层规划细粒度的交互轨迹,τ = π_f({ ̃I, D ̃ }, l, a_c)。为了实现第二个因素,为 π_f 集成多个分析成本函数,并在测试期间融入场景上下文和智体具身。这些约束指导轨迹生成过程,从而生成更合理、更能上下文-觉察的交互轨迹。

接触点 c 和交互轨迹 τ 将成为最终的 affordance 输出 a = {c, τ}。

在粗略阶段,粗略 affordance 模型旨在从高维图像空间中提取宏观可操作信息。为了实现这一点,通过学习粗略affordance 的概率及其对应的深度(适用的时候)在像素空间中表示粗略操作点。

精细 affordance 模型用于推断由接触点和目标点引导的细粒度交互轨迹。受[36]启发,精细阶段建模一个条件扩散去噪过程。

成本-引导轨迹生成

如果条件目标点 g ̄ 存在偏移,推断出的轨迹可能会出错。这是预料之中的,因为 π_f 本质上充当了接触点 c ̄ 和目标点 g ̄ 之间的间隙填充器。用于调节的最佳目标点并非总是基于预测分数来选择,而来自目标集 g 的多个目标点可以产生更多样化、更稳健的预测。然而,通过采样不同的目标配置来多次查询 affordance 模型在计算上效率低下。因此,将多目标调节转换为成本函数,以在测试期间引导轨迹生成。此外,成本函数还包括场景避撞引导和接触点法线引导。

其采用了 [32, 69] 中的重建引导。在轨迹生成过程中引入测试-时引导,有几个优点:1)轨迹可以更好地捕捉目标分布,而无需通过精细 affordance 模型进行大量的前向传递。2)可以考虑新具身的形态和以前未见过的物体几何,从而提供无碰撞的手部轨迹,并可轻松集成到下游全身规划中。3)每个轨迹的最终成本值 J 是智体选择最佳交互规划的参考标准。

Affordance 模型训练

为了训练粗略的 affordance 模型,即 π_cgoal 和 π_c^cont,将提取的目标点 gˆ 和接触点 cˆ 投影到图像平面,并通过拟合高斯混合模型获得真实概率,最终得到 Hˆ_g 和 Hˆ_c。目标深度 Dˆ_g,还通过 π_goal 进行回归,其是目标点的中值深度。引入一个辅助向量场回归损失 L_v,用于粗略的可供性模型训练。

模拟器环境。使用 IsaacGym [53] 作为基准测试的模拟平台,并基于 [43] 开发环境。从三个广泛使用的基准测试集(FrankaKitchen [30]、PartManip [24] 和 ManiSkill [29])中选择 13 项日常家务任务。这些任务包含打开、推动、滑动等基本动作,以及橱柜、抽屉和水壶等各种物体。每个任务从三个不同的视角进行评估。每个模型为每个视角生成五条轨迹,每个模型每个任务总共进行 15 次试验。评估方案使用先前研究中常用的成功率 (%) 来量化性能,其中成功的交互定义,为使任务目标的自由度 (DoF) 超过预先指定的阈值,并且不与场景中的其他物体发生碰撞。

基线模型。将模型与几个公开的代表性基线模型进行比较。具体来说,GAPartNet [25] 和 Where2Act [54] 是使用在模拟器中收集(并与之交互)的虚拟铰接体资产进行训练的。Octo [59] 在大规模遥控数据集 [60] 上进行了预训练,并使用收集的数据集进行进一步微调。VRB [4]、GFlow [92] 和模型都使用人类视频进行训练,而 GFlow [92] 可以访问 [50] 中的真值深度、相机参数和物体姿态。因此,VRB [4] 和模型可以在更多的野外环境中运行。遵循 [42] 中的策略,使用物体法线聚类作为线索,将像素级轨迹从 VRB [4] 提升到 3D。VRB [4] 和 GFlow [92] 等基线无法准确推断接触区域。为了确保公平比较,使用自己的模型来推断和标准化接触配置。因此,基准测试的重点是预测准确的交互轨迹,这比接触区域更具挑战性。

真实机器人。在两个现实世界的移动机器人平台上验证框架的有效性:Hello Robot Stretch 3 和 Boston Dynamics Spot(参见下图)。这两个机器人都配备用于感知的机载 RGB-D 摄像头,并接收用于操作任务的语言指令。在三种不同的适合人类的环境中测试机器人物理能力范围内的几项家务任务,例如推抽屉、打开橱柜和拿纸巾。总体而言,机器人在 55 次试验中取得 80.0% 的成功率,证明该框架的具身不可知性和零样本可迁移性。