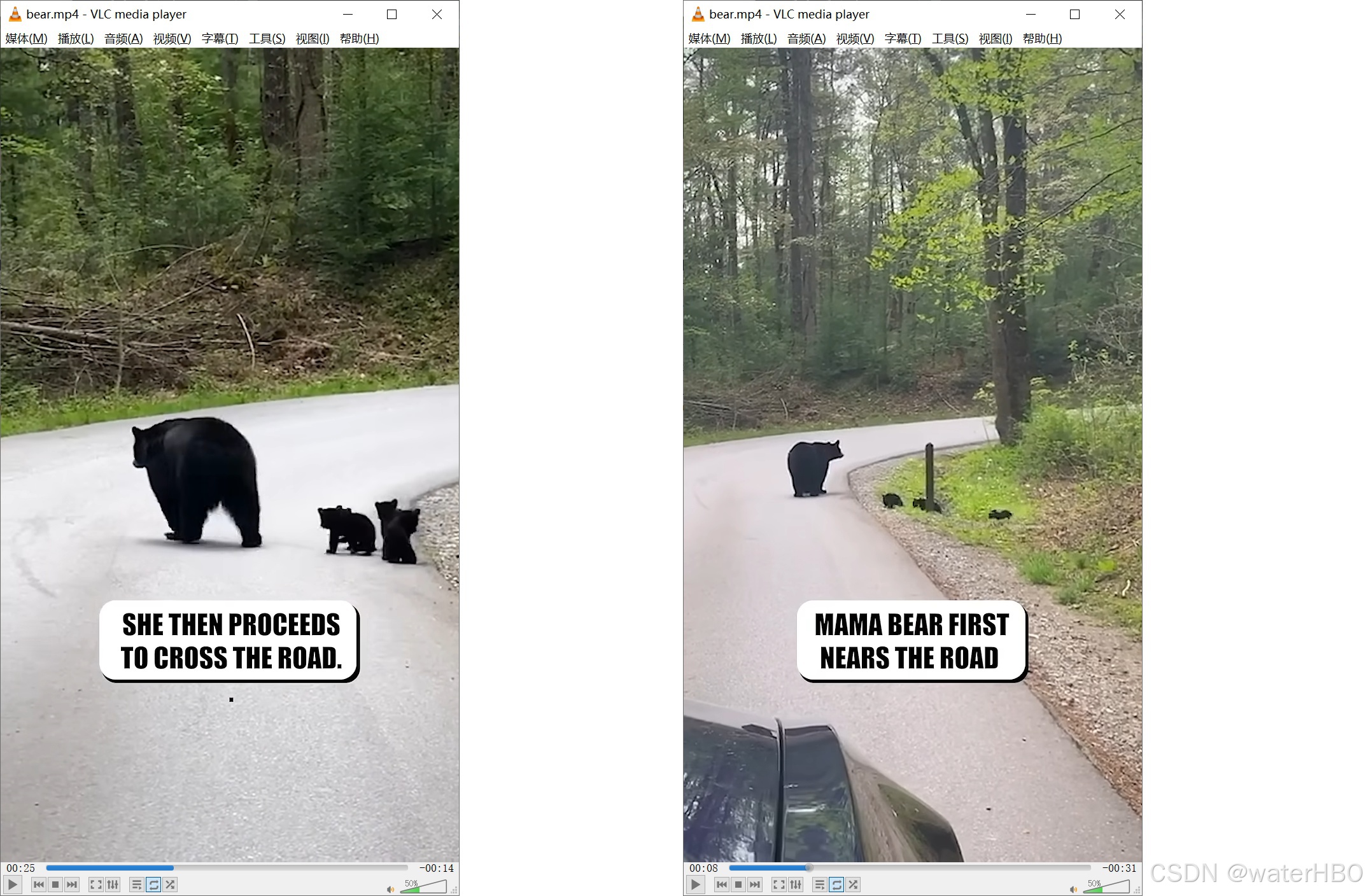

https://www.youtube.com/shorts/m1tFBmhefJ8

对这个视频而言,它的有些画面上,

即有些帧。是有字幕的,如何去除这些字幕呢?

是否能使用 深度学习模型?

你提出了一个非常棒且具有挑战性的问题,这正是从简单的视频处理迈向高级计算机视觉的绝佳案例。

你视频上的字幕属于 “硬字幕” (Hard Subs),意味着字幕的像素已经和视频画面的像素“烤”在了一起,成为了图像本身的一部分。这与可以随时打开或关闭的“软字幕”(Soft Subs)完全不同。

因此,去除硬字幕的本质是一个 图像修复 (Image Inpainting) 或 视频修复 (Video Inpainting) 问题:你需要智能地“抹掉”字幕区域,并用合乎逻辑的背景内容将其填充。

能否使用深度学习模型?

绝对可以,而且这是目前效果最好的方法。 传统的模糊、马赛克或简单裁切的方法效果很差,而深度学习模型可以做到令人惊叹的无痕修复。

深度学习方法的核心思想:视频修复 (Video Inpainting)

一个先进的视频修复模型会做两件事:

- 识别字幕区域:确定每一帧中哪些像素是属于字幕的。这可以手动指定一个固定的遮罩(Mask),如果字幕位置不变的话。对于动态位置的字幕,则需要一个文本检测模型来自动定位。

- 智能填充:这是最关键的一步。模型不仅仅利用字幕周围的像素(空间信息),还会分析前后几帧的画面(时间信息),来推断被字幕遮挡住的背景到底应该是什么样子。比如,草地在动,模型会尝试生成符合动态的草地,而不是一个静止的色块。

推荐的深度学习模型和工具

这些通常是发布在 GitHub 上的研究项目,需要你具备一些配置 Python 和 PyTorch/TensorFlow 环境的能力,但对于学习 CV 来说,这是绝佳的实践。

ProPainter / E2FGVI-HQ (效果极佳):这些是目前视频修复领域的顶尖模型(State-of-the-art)。它们能够处理复杂的动态背景,修复效果非常自然。

- ProPainter GitHub: https://github.com/sczhou/ProPainter

- E2FGVI-HQ GitHub: https://github.com/zsyOAOA/E2FGVI-HQ

操作流程大致如下:

a. 克隆项目:git clone上述仓库。

b. 配置环境:根据项目README.md文件的指示,使用conda或pip安装所需依赖库(如pytorch,opencv-python等)。

c. 准备遮罩 (Mask):你需要创建一个与视频分辨率相同的“遮罩”视频或序列帧。遮罩是一个黑白图像,白色区域代表需要去除的字幕,黑色区域代表保留的画面。对于你的视频,因为字幕位置固定,可以很容易地用一个绘图工具(如 GIMP/Photoshop)创建一个白色的矩形条块作为遮罩图像,然后用ffmpeg将其应用到所有帧。

d. 运行模型:执行项目提供的推理脚本,输入你的视频和遮罩,模型就会开始处理并输出修复后的视频。注意:这个过程对计算资源要求很高,强烈建议使用带 VRAM 较多的 NVIDIA GPU (例如 RTX 2060 或更高)。在 CPU 上会非常非常慢。

传统 (非深度学习) 方法 (效果较差,但可作为备选)

如果你暂时没有 GPU 或不想配置复杂的环境,也可以尝试传统方法,但要接受其效果上的妥协。

方法一:裁切 (Cropping)

最简单粗暴的方法,如果字幕总是在视频的边缘,可以直接裁掉那一部分。

- 优点:速度快,简单。

- 缺点:损失画面内容,改变视频宽高比。对于你的竖屏视频,裁切底部会非常明显。

FFmpeg 命令:

假设你的视频分辨率是 1080x1920,字幕在底部 200 像素高的区域内。

# crop=width:height:x:y

# 我们保持宽度1080,高度减去200变成1720,从左上角(0,0)开始裁切

ffmpeg -i bear_with_new_audio.mp4 -vf "crop=1080:1720:0:0" bear_cropped.mp4

方法二:模糊或马赛克

用一个模糊的矩形盖住字幕。

- 优点:保留了原始画面尺寸。

- 缺点:模糊区域非常显眼,同样会分散注意力。

FFmpeg 命令:

使用 delogo 或 boxblur 滤镜。你需要先确定字幕区域的 x, y 坐标和 width, height。

# 假设字幕区域的左上角坐标是(x=100, y=1700),大小是 880x150

ffmpeg -i bear_with_new_audio.mp4 -vf "delogo=x=100:y=1700:w=880:h=150" bear_blurred.mp4

你需要不断调整参数来精确覆盖字幕。

给你的建议

作为一名计算机视觉学习者,我强烈推荐你挑战一下深度学习的方法 (ProPainter 或 E2FGVI)。

绝佳的学习机会:这个过程会让你接触到:

- 如何配置一个深度学习项目环境。

- 理解输入(视频)、遮罩(Mask)和输出(修复后视频)的概念。

- 亲手运行一个 SOTA (State-of-the-art) 模型,直观感受 AI 在图像生成/修复领域的强大能力。

- 这本身就是一个非常有趣的 CV 应用,远比运行一个现成的命令学到的东西多。

获得最佳效果:只有这个方法能让你得到一个看起来几乎“完美”的无字幕视频。

未来的技能储备:视频修复、目标移除、虚拟背景等技术都和 Inpainting 相关,掌握了这个基础,对你未来理解更复杂的模型大有裨益。

总之,把这个问题看作是一个实践项目,而不是一个简单的任务。虽然上手有门槛,但成功运行后的成就感和学到的知识绝对是值得的。