目录

神经网络是一个函数(用 f 表示),它试图近似另一个目标函数 g ,可以用一下公式来描述这种关系:

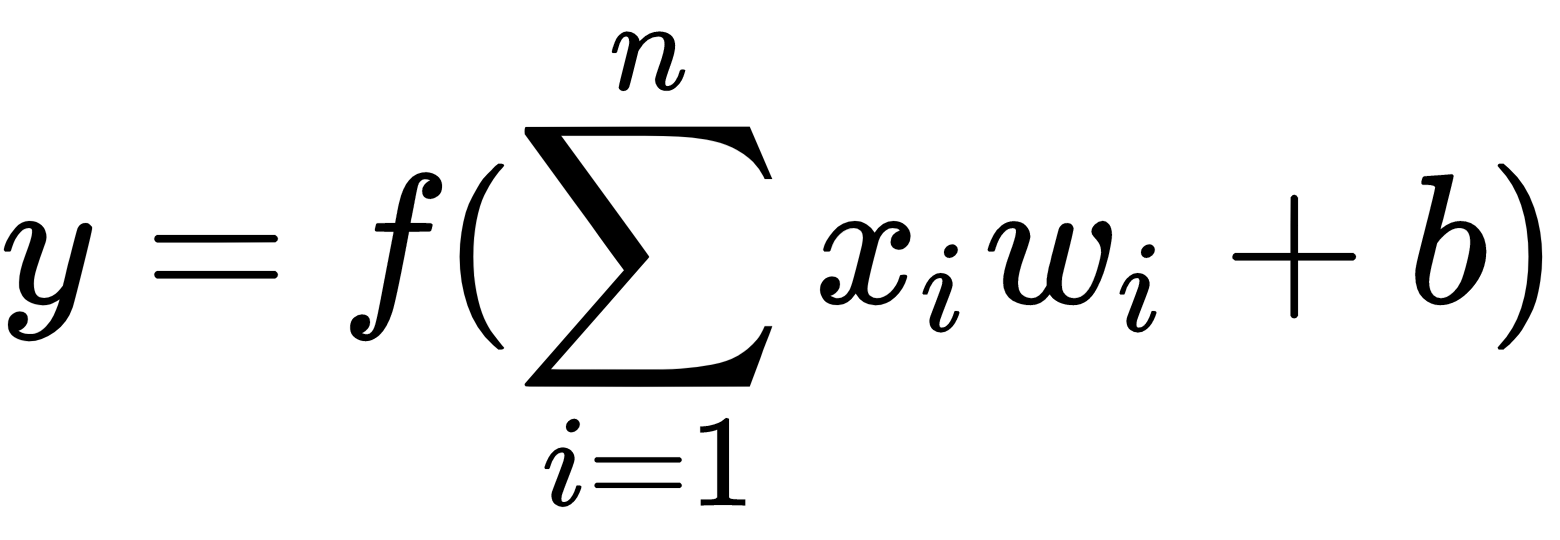

1.神经元

神经网络的基本构件,既神经元(或单元)。单元是数字函数,其定义如下:

在二维输入的时候,可以将神经元看作一个感知器,感知器是一个有阈值激活函数,可以将输入分为两类中的一个。

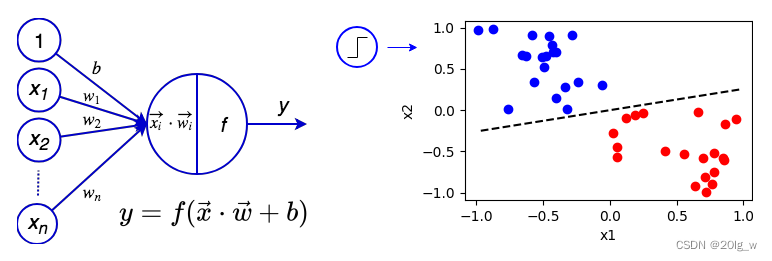

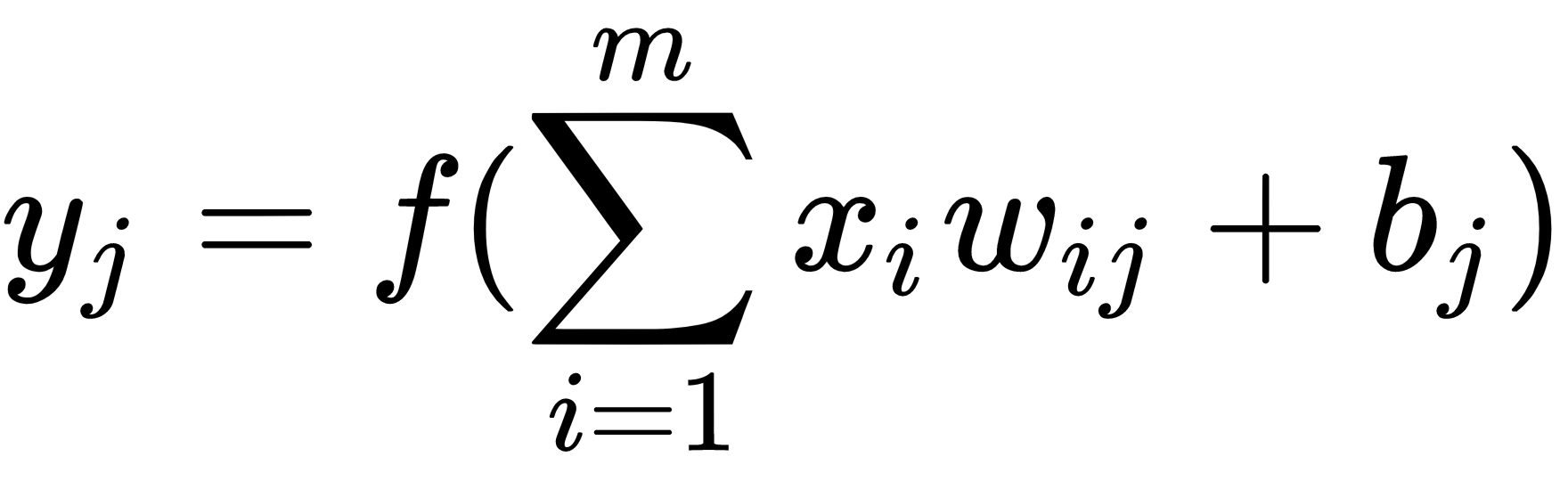

2.层的运算

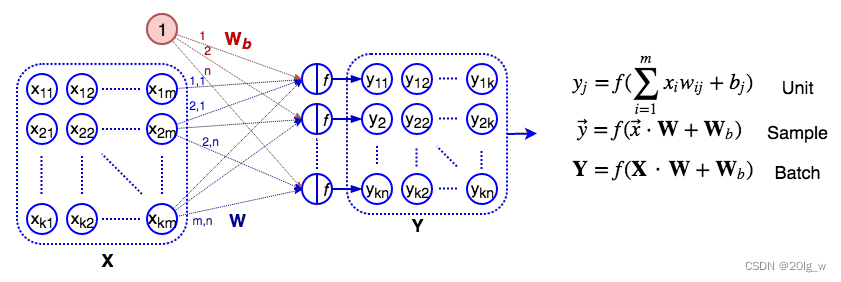

神经网络组织结构的下一层是单元层,其中将多个单元的标量输出组合在一个输出向量中。

在经典的神经网络中,层的主要类型是全连接层

神经网络不限于全连接层,还有许多其它类型,比如卷积层,池化层等。

有些层具有可以训练的权重(全连接层、卷积层),而其它层没有(池化层)。

3.神经网络

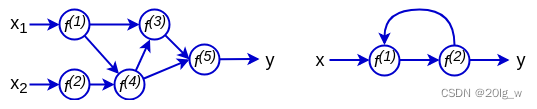

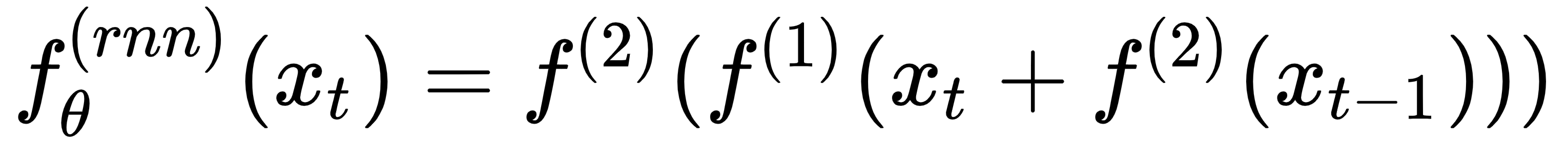

一个神经元只能分类线性可分的类。为了克服这一限制,必须在一个神经网络中组合多个层。

有点像自控中的传递函数。

4.激活函数

几种经典的激活函数

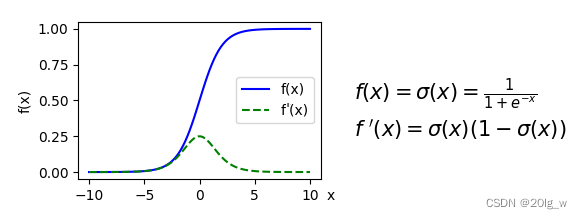

sigmoid:它的输出边界在0和1之间,可以解释为神经元激活的概率。

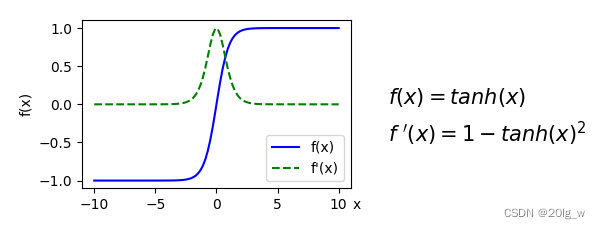

双曲正切(tanh):和sigmoid区别是范围是(-1 ,1)

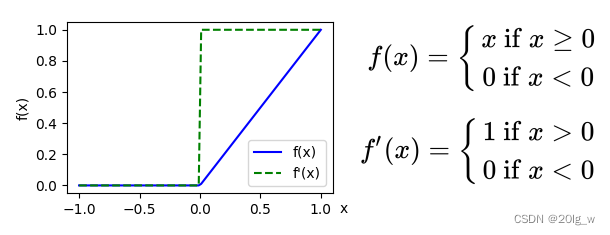

Relu:线性整流函数

Leaky ReLU:

学习的书籍是

Python深度学习——模型、方法与实现(lvan Vasilev)著

本文含有隐藏内容,请 开通VIP 后查看