今天是周日,我来解读一篇有趣的文章——xDeepFM。这篇文章由 Mao et al. 发表在SIGIR 2019会议。文章提出了一个新的网络模型——压缩交互网络(CIN),用于显式地学习高阶特征交互。通过结合 CIN 和传统的深度神经网络(DNN),形成了一个新的模型 xDeepFM。该模型能够同时学习显式和隐式的高阶特征交互,极大地减少了手动特征工程的工作量,并且在多个真实数据集上表现优异,超越了传统的模型如 FM 和 DeepFM。这项工作对提升特征交互学习的效率具有重要意义,尤其在推荐系统等领域的应用中,可以帮助我们更好地捕捉用户行为和产品特征之间的复杂关系。

接下来,我将深入对这篇论文展开全面解读。和以往一样,我会严格依照论文的结构框架,从研究背景、核心论点、实验设计到最终结论,逐一对文章的各个关键部分进行细致剖析 ,力求为大家呈现这篇时间序列预测论文的全貌,挖掘其中的研究价值与创新点。

1. Abstract

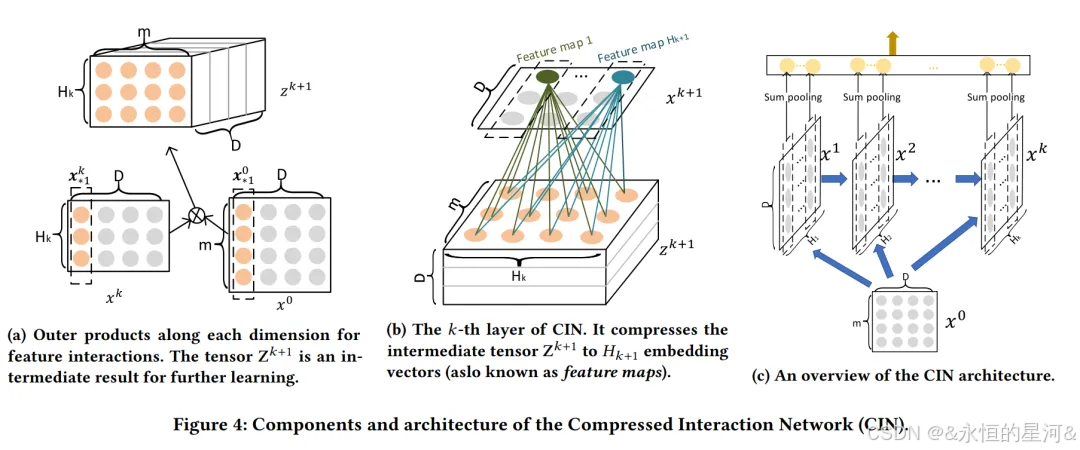

组合特征在许多商业模型的成功中起着至关重要的作用。然而,由于Web规模系统中的原始数据具有多样性、海量性和高速性,人工构造这些特征通常代价高昂。基于因式分解的模型可以通过向量乘积的方式自动学习组合特征之间的模式,并且具有对未见特征进行泛化的能力。随着深度神经网络(DNN)在各个领域取得巨大成功,研究人员最近提出了一些基于DNN的因式分解模型,旨在同时学习低阶和高阶的特征交互。尽管普通的DNN具备从数据中学习任意函数的强大能力,但其生成特征交互的方式是隐式的,且仅在比特级别进行。在本文中,提出了一种新颖的压缩交互网络(Compressed Interaction Network, CIN),其目标是以显式方式、在向量级别生成特征交互。本文展示了CIN在功能上与卷积神经网络(CNN)和循环神经网络(RNN)有相似之处。作者进一步将CIN与经典的DNN结合,构建了一个统一模型,并将其命名为极深因式分解机(eXtreme Deep Factorization Machine, xDeepFM)。一方面,xDeepFM 能够显式地学习某些有界度的特征交互;另一方面,它也能隐式地学习任意的低阶和高阶特征交互。在三个真实世界的数据集上进行了全面的实验,结果表明,xDeepFM 优于当前最先进的模型。

2. INTRODUCTION

特征在许多预测系统的成功中起着核心作用。由于直接使用原始特征很少能获得最优效果,数据科学家通常需要投入大量工作,对原始特征进行转换,以构建出性能最佳的预测系统,或在数据挖掘比赛中取胜。一种主要的特征转换方式是对类别特征进行交叉乘积转换。这些特征被称为交叉特征或多维特征,它们用于衡量多个原始特征之间的交互关系。例如,一个三维交叉特征 AND(user_organization=msra, item_category=deeplearning, time=monday) 的取值为 1,表示该用户所在公司为 Microsoft Research Asia、当前展示的内容是关于深度学习的技术文章,且时间为周一。