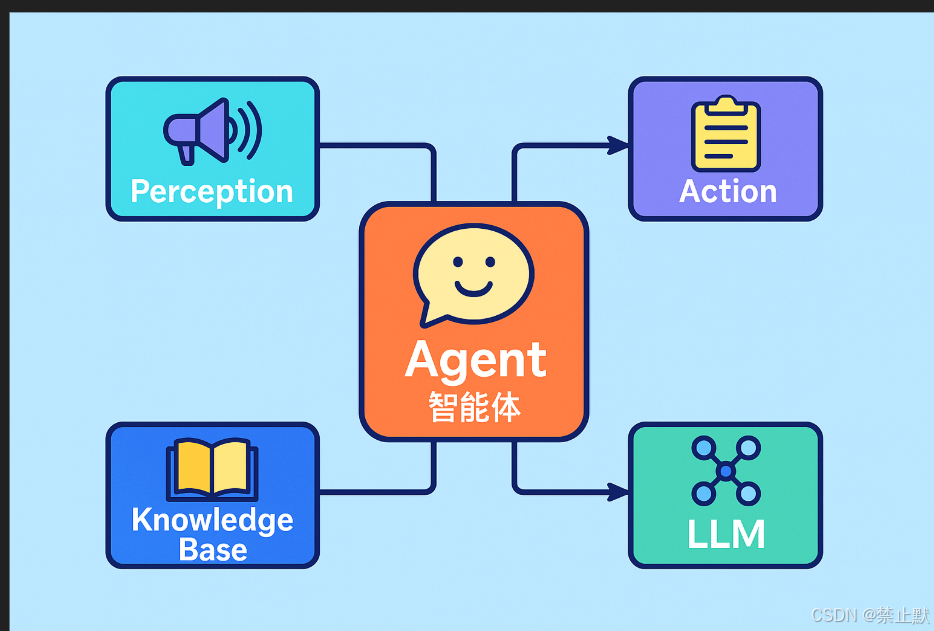

在大语言模型(LLM)驱动的智能体(Agent)快速发展的今天,构建一个实用、智能的Agent已不再遥不可及。无论你是开发法律助手、租房合同分析器,还是通用办公自动化助手,理解提示词工程(Prompt Engineering)、选好合适的框架(如LangChain、AutoGen、Semantic Kernel)并建立良好的工作流,都是高效落地智能体项目的关键。

本文将深入剖析这三大要素,帮助从“调用API”迈向“构建系统级智能体”。

🧠 一、提示词(Prompt)是智能体的大脑语言

1.1 什么是提示词?

Prompt 是用户与大模型交流的语言,决定了模型的行为方式。优秀的 Prompt 不仅能提升模型的输出质量,还能引导其模拟不同身份、执行特定任务。

1.2 提示词类型

| 类型 | 示例 | 应用场景 |

|---|---|---|

| 指令型(Instructional) | “请将以下文本翻译成英文。” | 翻译、摘要、分类 |

| 角色设定(Persona) | “你是一位专业的租房法律顾问。” | 法律、医疗、金融场景 |

| Chain-of-Thought(CoT) | “请一步步推理。” | 数学题、逻辑判断 |

| Few-shot Prompting | 给出几个示例再提问 | 低样本分类、问答 |

| ReAct Prompting | 推理+行动+工具调用 | 多轮任务智能体(如AutoGPT) |

1.3 提示词设计技巧

明确身份:模型表现与角色描述息息相关

逐步引导:复杂任务应逐步分解,类似编程中的“函数化”

限制风格:控制语气/长度/格式可避免胡言乱语

使用模板工具:如LangChain的

PromptTemplate、PromptLayer等可管理和调试Prompt

🧱 二、智能体开发框架选型对比

目前已有多个优秀的智能体开发框架,大大简化了LLM+工具+记忆的整合难度。以下是主流框架简析:

2.1 LangChain(Python / JS)

最流行的智能体框架,社区活跃、生态丰富。

✅ 支持:

Prompt 模板系统

多种Memory(Buffer, Summary)

工具调用(Tool / AgentExecutor)

向量检索(FAISS, Chroma等)

支持OpenAI、Anthropic、Llama等

📦 安装:

pip install langchain openai🧠 示例:一个简单问答 Agent

python

from langchain.chat_models import ChatOpenAI

from langchain.agents import load_tools, initialize_agent

llm = ChatOpenAI(model="gpt-4")

tools = load_tools(["serpapi", "llm-math"], llm=llm)

agent = initialize_agent(tools, llm, agent="zero-shot-react-description", verbose=True)

agent.run("明天北京的天气是多少度?")

2.2 AutoGen(Microsoft)

面向“多智能体协作”的框架,适合构建复杂系统(如AI决策助手、写作机器人团队)。

特点:

多Agent协作流程(UserProxy、Assistant)

可构建“自循环”Agent(如AutoGPT)

强交互、适合产品化

2.3 Semantic Kernel(C# / Python)

微软主推,面向企业开发,强调插件化、语义技能集成。

适合场景:

.NET 生态开发者

微服务场景

插件与业务逻辑融合

2.4 LlamaIndex(原GPT Index)

主打“文档问答”,可将本地知识接入LLM。

文档加载器丰富

支持RAG(检索增强生成)

可和LangChain联合使用

🔄 三、开发一个智能体的典型工作流

3.1 明确任务目标

智能体类型:对话、问答、任务执行?

目标用户是谁?专业领域?是否需要上下文记忆?

是否需要工具使用(如数据库、搜索、计算器)?

3.2 数据准备

是否有知识库?是结构化(数据库)还是非结构化(PDF、文档)?

是否需要构建向量索引(如用 FAISS)?

是否需要微调模型(如自定义领域GPT)?

3.3 提示词开发(Prompt Engineering)

编写初始提示词

增加 Few-shot 示例、CoT、角色设定

尝试不同策略(Zero-shot、ReAct、Tree of Thought)

多轮测试 + 评估输出合理性

3.4 工具集成与逻辑控制

是否要接入外部 API(如天气、新闻、搜索)?

使用LangChain的 AgentTool 模块或自定义函数

结合任务计划(Task Planner)或多Agent协作(AutoGen)

3.5 增加记忆能力

使用 LangChain 的 Memory 模块

存储对话历史、用户信息

增加“长期记忆”模块(如 MongoDB + 向量数据库)

3.6 接入应用层(前端/UI/API)

使用 FastAPI / Flask 构建后端服务

接入 Web、微信小程序、桌面端、VS Code 插件等

加入身份验证、日志记录、权限控制等

🧩 示例:构建一个“租房合同审查”智能体

目标:用户上传合同,智能体标记潜在法律风险并解释条款含义

关键模块:

文档解析:PDF文本抽取(pdfplumber、unstructured.io)

嵌入存储:向量化+FAISS

Prompt模版:设定法律顾问身份

工具:调用外部法律法规查询接口

UI:可通过 Streamlit / React + Flask 构建 Web 工具

🧠 总结:三者结合,打造真正的智能 Agent

| 模块 | 作用 | 推荐工具 |

|---|---|---|

| Prompt | 驱动智能体行为,控制输出质量 | LangChain PromptTemplate, PromptLayer |

| 框架 | 模块化开发,整合记忆、工具、知识库等 | LangChain, AutoGen, Semantic Kernel |

| 工作流 | 保障从开发到上线的过程稳定可控 | 开发流程模板 + 工程化部署方案 |

当理解并掌握这三者的核心后,就可以灵活地打造出具备“理解+推理+行动+记忆”能力的高级智能体了。