上个月,DeepSeek悄悄做了一次更新,发布了一个小版本:DeepSeek-V3-0324。

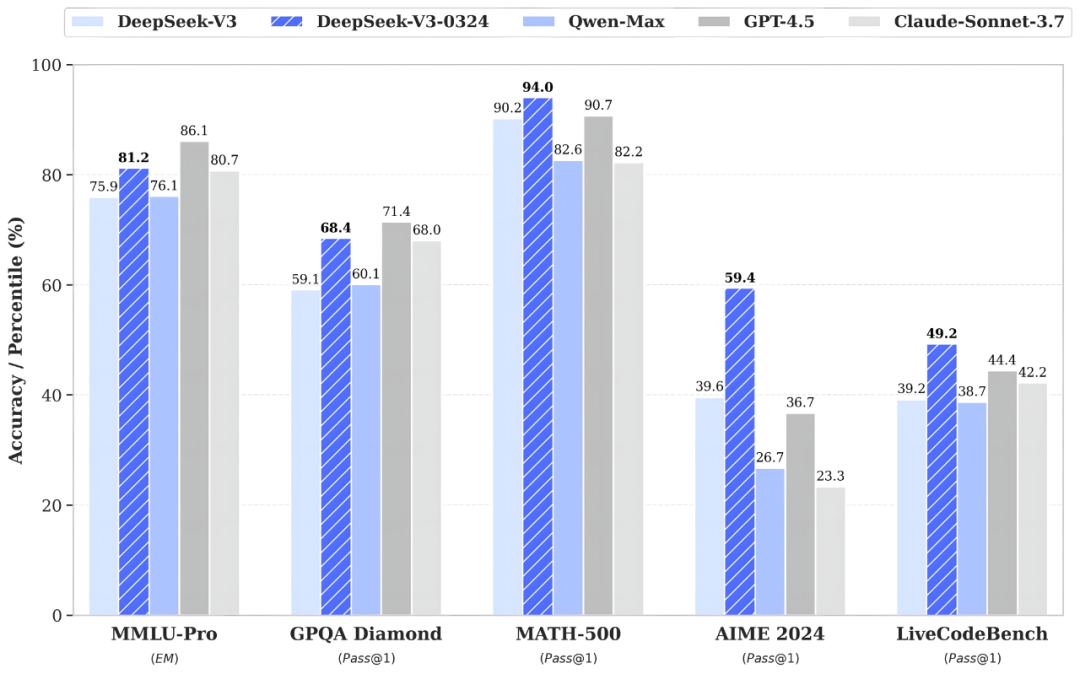

这个版本大幅提高了在推理类任务上的表现水平,在数学、代码类相关评测集上取得了超过 GPT-4.5 的得分成绩。

怎么做到的呢?DeepSeek官方文档是这么说↓

新版 V3 模型借鉴 DeepSeek-R1 模型训练过程中所使用的强化学习技术,与之前的 DeepSeek-V3 使用同样的 base 模型,仅改进了后训练方法。

这里面提到了一个词:后训练。

啥是后训练,跟预训练有啥区别?

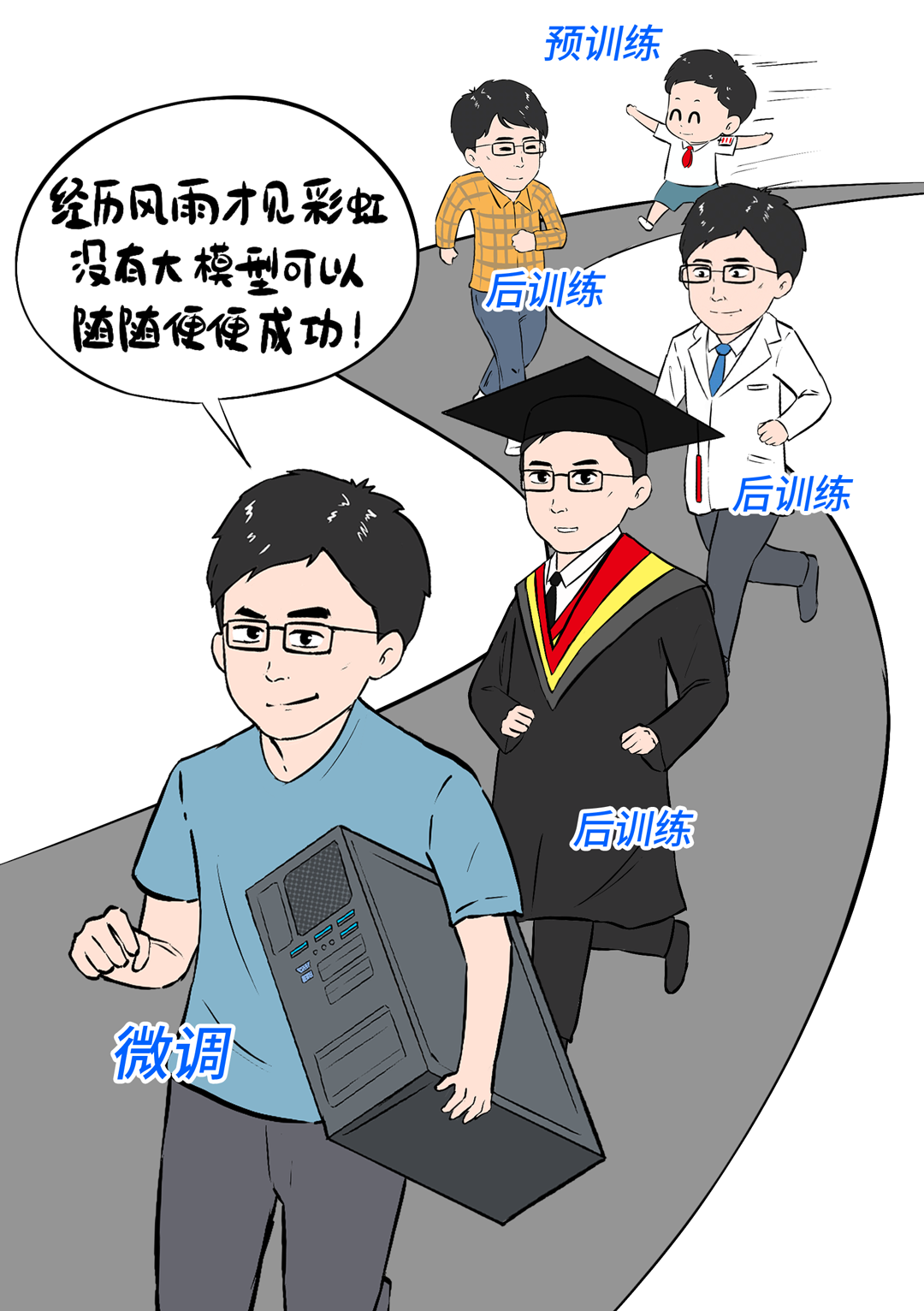

今天我们用最通俗的比喻,来讲讲大模型三个不同阶段的训练方法:❶预训练(Pre-training)❷后训练(Post-training)❸微调(Fine-tuning)。

![]()

先看预训练

![]()

预训练就是用大量的通用数据集先训练模型,让它掌握基础知识和技能(通用语言能力和世界常识,比如刚发布的Llama 4在200种语言上进行预训练)。

这就好比我们的中小学阶段,系统地学习语文、数学、英语等基础学科知识。

这个阶段数据规模庞大,训练成本高,周期长(数万GPU天),比如Llama 4 Scout预训练就使用了40万亿tokens数据。

想想我们小时候刷过的题、吃过的苦、花费的时间、挨过的骂……

预训练的成本和时间一下子就具象化了。

![]()

再说后训练

![]()

后训练是指在预训练完成后的进一步训练阶段,目的在于让模型更好地适应实际的特定任务或应用场景。

这就好比高中毕业(预训练结束),考上大学,有了明确的专业方向,开始强化专业知识。

后训练阶段,数据规模小,通常是特定领域的数据(专业基础课和专业课),训练周期短(修够学分就行)。

回想一下你的大学生活,是不是比以前轻松多了

![]()

。

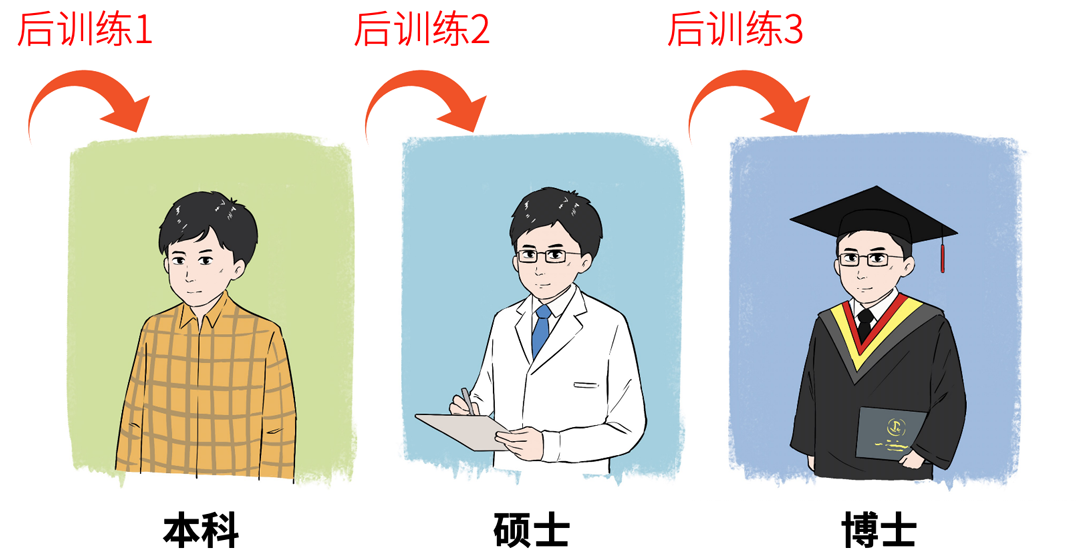

不过,后训练往往不止一次,可能要根据实际需求,持续深造,不断优化。

这就好比我们上完本科,可能还要硕士、博士,持续深造,让自己的专业能力越来越扎实。

目前,在模型后训练环节,比较流行的是采用强化学习(RL:Reinforcement Learning)的方法。比如在DeepSeek-V3小版本发布的通告里,就特别指出了自己采用了强化学习进行后训练。

简单讲,强化学习就后训练的过程中不断告诉模型:①你做得好,继续保持(给正反馈);②你做的不好,赶紧改正(给负反馈)。

通过这种“奖惩机制”,让模型学习更有针对性,表现也更好。

但是这种”打一巴掌、给个甜枣“的方法,有时候会把模型心态搞崩,太过于追求奖励的结果了而走极端。

所以,为了避免走极端,最近流行一种新的强化学习方法,叫做GRPO(引导式正则化策略优化),比如DeepSeek R1的训练就采用了这种方法。

GRPO就是在传统强化学习的奖励机制之上,加入一个额外的约束(正则项),确保和最初的“比较好的模型”不会差距太大。

这样模型就可以平稳地进步,既能拿到高奖励,又不会走极端。

如此,GRPO成了当下大模型后训练中,最流行的强化学习手段,能更安全、稳定地提升AI的表现,生成的内容更符合人类喜欢的风格和预期。

![]()

最后说说微调

![]()

严格来讲,把微调单拎出来讲并不科学,因为微调其实也是模型「后训练」的一种方法。

不过,一般后训练(像前面说的强化学习方法),发生在模型提供商那里。模型提供商在「预训练」完成以后,通过多次「后训练」优化,最终把模型打造成可交付的产品或服务。

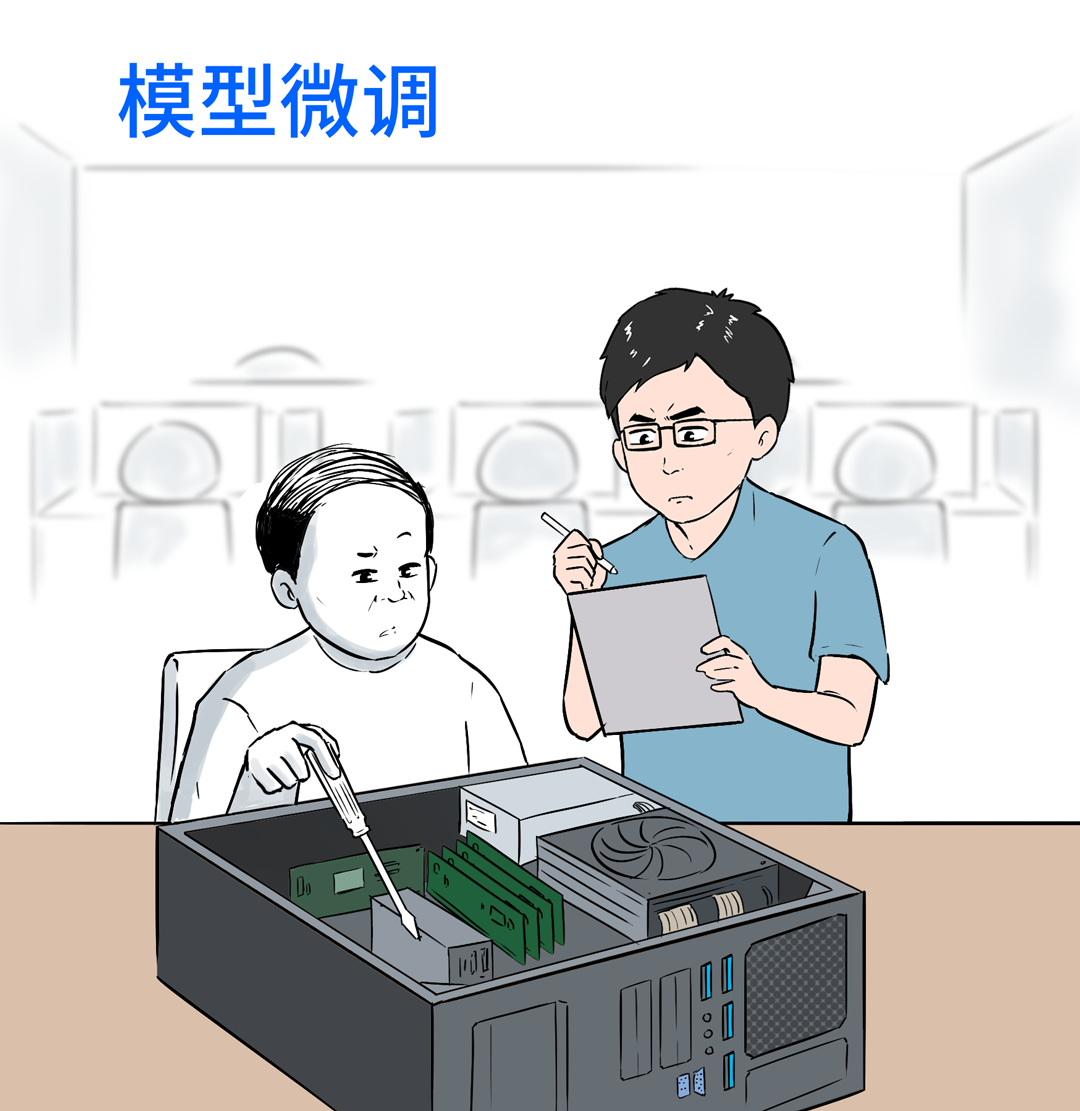

而微调这种「后训练」,通常发生在模型使用者那里(尤其是行业客户场景)。

只因出徒后的大模型虽然基础知识丰富、专业能力一流,可是实战技巧却是空白,到了行业场景没法直接上岗。

比如——

怎么办呢?进行上岗培训,这就是微调。

微调是针对特定任务(修电脑)的训练,数据量小但很精准、具体,老司机会把他的具体修理经验交给你,让你的知识更接地气。

至此,一个大模型经过预训练、后训练、微调。

终于可以上岗干活啦。

简单总结下↓

预训练:基础知识广泛学;

后训练:专业领域深入学;

微调:具体实操岗前学。

好了,基本概念介绍完毕。

从目前的国内的趋势看,做大规模预训练的公司会越来越少(坊间传闻,今年上半年真正在做预训练的公司只有两三家)。

未来训练方面的主要需求都是后训练和微调(当然更大的需求是推理)。

可是说,随着DeepSeek的半路杀出,国内大模型战役的第一阶段,已经结束,“裸泳者”即将浮出水面。